Cuando la IA se convierte en médico de bolsillo

En España, algo curioso está ocurriendo en las búsquedas dirigidas a sistemas de inteligencia artificial. Mientras millones de usuarios preguntaban a ChatGPT, Gemini y otros chatbots sobre sus hábitos de fumar, se reveló un patrón fascinante: los españoles no buscan simplemente respuestas sobre el tabaco, sino validación, alternativas y explicaciones que sus médicos quizá no tienen tiempo de proporcionar.

Este fenómeno refleja una transformación silenciosa en la forma en que accedemos a información sobre salud. Ya no es únicamente el consultorio médico o una búsqueda pasiva en Google. Ahora preguntamos directamente a máquinas entrenadas con millones de textos, esperando que nos comprendan con la empatía de un profesional y la accesibilidad de un amigo disponible a las 3 de la mañana.

Las preguntas revelan lo que realmente nos preocupa

¿Cuánto fuman realmente los españoles? ¿Qué sustancias específicas dentro de ese cilindro de tabaco envuelto en papel son las que nos están matando lentamente? ¿Existen opciones menos dañinas? Estas no son preguntas triviales. Son las preguntas que alguien plantea cuando está considerando cambiar su relación con la nicotina.

Lo interesante es que estas consultas a la IA sugieren algo que los estudios epidemiológicos confirman: la mayoría de fumadores conocen los riesgos generales, pero desconocen los detalles. No saben exactamente qué hace el monóxido de carbono versus el alquitrán. No comprenden por qué nicotina sola sin humo sería teóricamente menos letal. Y honestamente, tampoco confían en que les digan la verdad completa en medios que pueden estar capturados por intereses corporativos.

Una pausa latinoamericana en este análisis

Desde la perspectiva de América Latina, donde el consumo de tabaco sigue siendo un problema de salud pública significativo, este fenómeno español es especialmente relevante. En países como México, Colombia y Perú, el acceso a información médica confiable es aún más limitado que en Europa. La penetración de inteligencia artificial conversacional es menor, pero crece aceleradamente entre poblaciones urbanas.

Si los españoles ya están delegando preguntas de salud a chatbots, ¿qué sucederá en contextos donde los sistemas de salud pública están más debilitados? ¿Se convertirá la IA en una forma de democratizar el acceso a información médica, o simplemente replicará los sesgos y lagunas de conocimiento que ya existen?

Las respuestas de la IA: ¿suficientemente precisas?

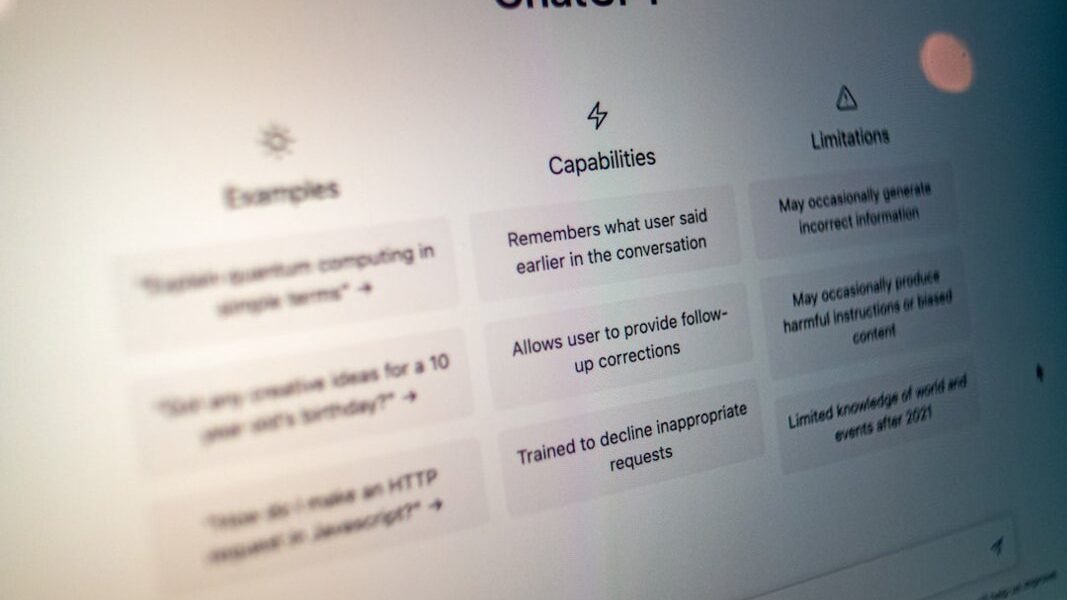

Aquí reside el quid del asunto. Los sistemas de inteligencia artificial pueden proporcionar información factual sobre composición de cigarrillos, estadísticas de consumo y riegos comprobados. Pero tienen limitaciones críticas. Primero, su conocimiento tiene una fecha de corte. Segundo, pueden cometer errores que suenan creíbles. Tercero, y lo más importante: carecen del contexto personal para dar recomendaciones verdaderamente personalizadas.

Un chatbot puede decirte que el alquitrán causa cáncer. Pero no puede evaluar tu situación específica, tu historial genético, o los factores socioeconómicos que hacen que dejar de fumar sea exponencialmente más difícil para algunas personas que para otras.

Por qué esto importa más allá de lo obvio

Este cambio en el comportamiento de búsqueda señala que la salud pública está migrando hacia plataformas privadas. OpenAI, Google y Meta ahora son, de facto, proveedores de información médica de primera instancia para millones de personas. Ninguno de ellos tiene obligaciones de salud pública. Ninguno de ellos tiene médicos en nómina responsables legalmente por la exactitud de sus respuestas.

Mientras gobiernos españoles y latinoamericanos debaten cómo regular la IA, poco se habla de este aspecto: la capacidad de estas empresas para moldear decisiones de salud críticas sin supervisión médica.

Lo que deberíamos estar preocupados

No es que la gente haga preguntas a la IA sobre tabaco. Es que sientan que tienen que hacerlo porque no confían en otras fuentes, o esas fuentes no están disponibles. Y es que cuando hayan recibido la respuesta, creerán estar armados de conocimiento suficiente para tomar decisiones sin consultar a un profesional real.

La IA puede ser una herramienta valiosa para desambiguar información sobre sustancias tóxicas. Pero jamás debería reemplazar una consulta médica verdadera. El peligro no está en la tecnología. Está en confundir acceso a información con acceso a cuidado genuino.

Información basada en reportes de: Elconfidencial.com